隨著社交媒體的普及,極端言論的傳播變得更加容易。今年8月發表在 Nature

的一篇研究表明,在極端言論傳播的小世界網絡中,關鍵詞屏蔽等傳統監管方式不僅效果不佳,更可能起到反作用。

本期全媒派(ID:quanmeipai)受權轉載集智俱樂部(ID:swarma_org)的文章,帶大家看看對網絡極端信息的監管,怎樣才最行之有效。

極端言論自古有之,例如名著《飄》出現3K黨,如今依然在美國南方不時露出獠牙。互聯網和社交媒體的普及,使得極端言論的傳播變得更加容易,任何人都可以在

Facebook 上開設公共賬號,在短時間讓極端言論觸及數萬人,這使得監管機構麵臨的問題變得更加棘手。

傳統智慧告訴你要抓大放小,先管好主流的社交媒體,但 Nature 主刊今年8月底的一篇文章指出這樣做會適得其反。

極端信息的傳播網絡是複雜的

這篇 Nature 文章的標題中的關鍵詞是 Hidden resilience

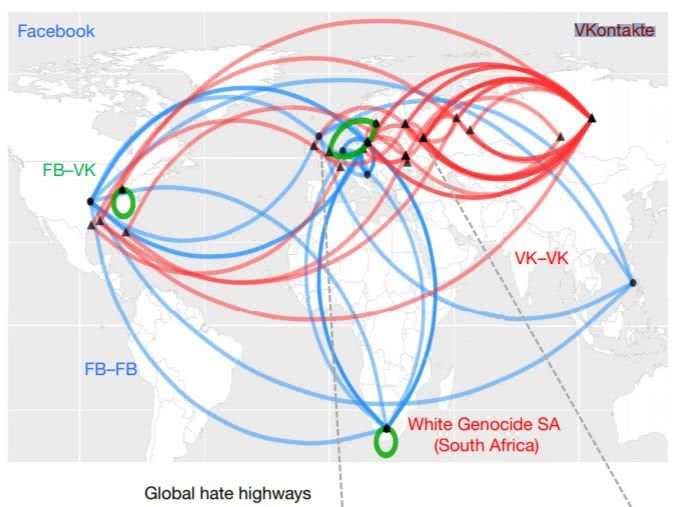

,即隱藏的彈性。這是一個來自生態學的術語,講述的是生態係統在遭到外界打擊後,由於網絡結構,得以快速回到之前的狀態的能力。該文將社交網絡中的極端言論當成是生態係統中的物種,首先指出了極端言論在不同平台之間的傳播是一站式的某種極端言論可以一次性從一個地區傳播到另一個地區。

下圖中的 VKontakte(以下簡稱VK)是俄語世界的主流社交媒體,圖中紅色的是 VK

平台之間傳播的仇恨言論,藍色的是在臉書平台之間傳遞的仇恨言論,綠色代表是是跨平台的傳播。

上圖為極端信息在不同平台間的複雜傳遞網絡

上圖展示了對歐洲部分的進行了縮放的效果

從上麵的例子中可以形象地看到,極端言論的傳播網絡是去中心化的,也就是一個小世界網絡,沒辦法找到一個核心節點,從而一勞永逸地解決問題。該研究中,作者關注的是泛指的極端言論,而不是某一個特定的主題,例如

ISIS 、新納粹等。文中指出,這些言論的共同點是充滿了偏激和仇恨,盡管仇恨的對象不同(可以是外來移民、同性戀者等)。

根據自動化的圖像識別(例如識別血腥暴力的照片)以及文字主題分類,再加上手動的篩選,作者給出了一個包含768個節點(傳播極端言論的賬號),578條邊的網絡。

極端信息傳播網絡,存在無標度特性

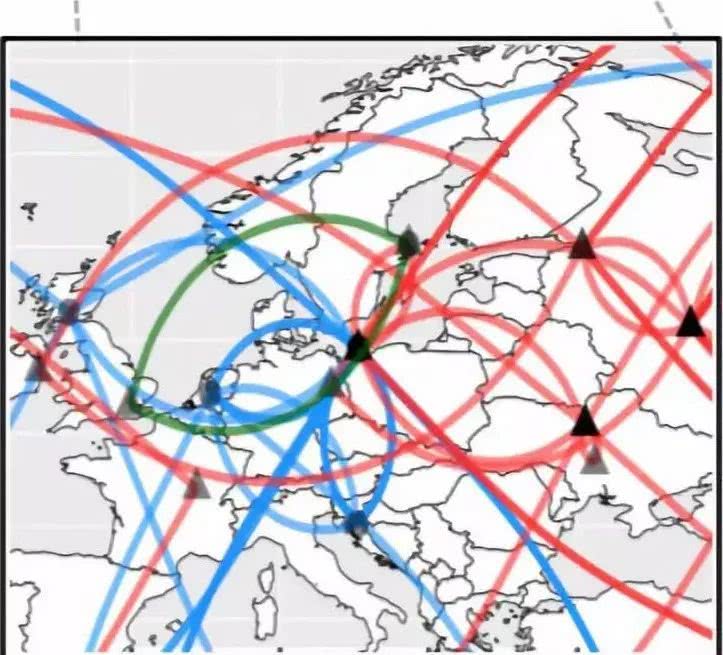

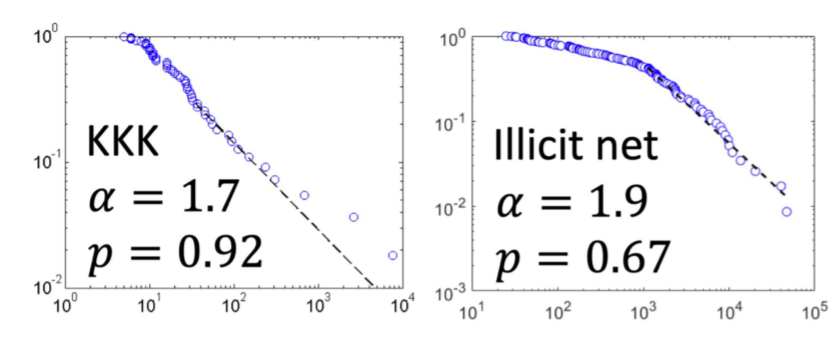

在更細的尺度上來看,下圖展示的是六十多個和3K黨有關的極端言論,右圖中的每個黑點代表一個社交媒體的用戶,每個白點代表細分後的一個包含和3K黨有關的主題。每個主題會形成一個聚簇,其關注人數在數十人到數萬人之間。用戶之間也會形成一個聚簇,用戶聚簇的人數從一個到數百個不等。左圖的宏觀視角,不同聚簇的大小代表了關注的用戶數,其距離越遠,兩個主題間共同關注的用戶越少。

六十多個和3K黨有關的極端言論形成的聚簇

該聚簇的大小歸一化後,計算不同大小的極端言論主題簇對應的用戶數的分布,可以看出明顯的指數分布。

網絡具有無標度特性,這意味著這樣的網絡更有可能具有嵌套性,而嵌套性的網絡在遭到外部打擊時能迅速複原。

在不同平台之間,當一個平台對某一個主題的極端信息進行取締後,該主題對應的用戶可以遷移到其他的主題上,往往還會使用其他的文字或梗,對極端信息進行加密,這使得新信息更難以被針對英語的自動監控算法檢測。如果隻是根據常識,沒有注意到極端言論的傳播網絡的特征,簡單的信息屏蔽隻會使得極端言論如野草一樣殺不盡,這也是標題中

Hidden resilience 所要概述的發現。

通過數學模型說明

不同平台監管力度不同造成的反作用

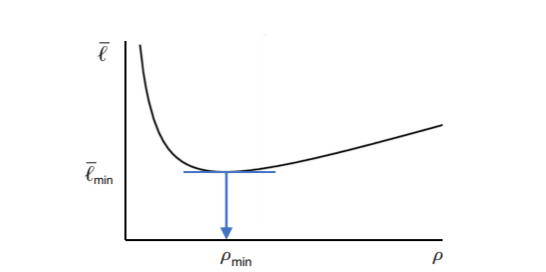

數學模型能夠量化地說明在何種情況下,會發生怎樣預期的結果,以及應該采取怎樣的應對策略最優。本文提出的模型,假設傳播極端言論的不同用戶在社交平台之間會選擇最短路徑,在不同平台、不同主題的極端言論間進行遷移,但這樣的遷移是有成本的。限於篇幅,不對模型進行詳解,隻簡單說說模型得出的結論。

假設有兩個社交媒體,A 對極端言論有較好的監管,B 則缺少監管。下圖的縱軸是 B

平台上不同主題的極端言論之間的最短距離(最少需要多少用戶才能相連)的均值,橫軸是不同主題聚簇之間的總連接(用戶和極端主題之間的邊)。

通過該圖,模型指出,如果隻在 A 平台對極端言論進行監管,當 B

平台的用戶和極端言論的連接數大於某一閥值時,會導致從整體上來看,不同主題的極端言論聯係距離更遠,從而使得進一步的打擊變得更加困難(更加去中心化)。

隻針對某一平台的極端言論進行封殺,帶來全網極端言論的進一步分散

針對極端言論的四種應對方法

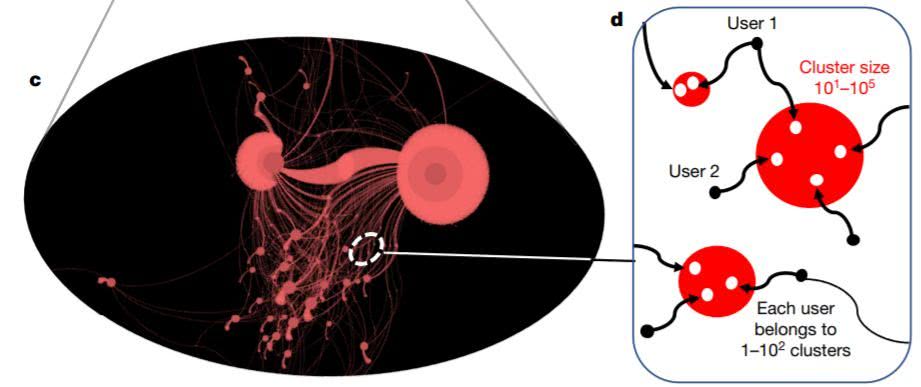

該文的另一大貢獻是按照兩個維度,區分出了四種應對極端言論的策略,以及在數學模型模擬的情況下,這四個策略各自的效果。限於篇幅,這裏隻對這四類策略進行概述,論文的補充材料中對此有詳細分析。

不同維度下的四種應對極端言論的策略

橫軸表示幹預的粒度,縱軸表示幹預的方式(自上而下或自下而上)。

左上角的方法是刪貼找到特定主題的帖子,全部禁掉;該方法的幹預尺度較粗,這樣做帶來的反作用是會讓極端分子遷移到另一平台,並沒有治本。

右上角的方法是刪號;這是更細致的幹預,但大多數人都擁有多個社交平台的賬號,因此這種方法也隻是一時之計。

右下角的策略是培養一批能夠發出中和極端言論的用戶,如圖中的綠色圈子中的用戶,讓其作為社交網絡上的免疫係統,從而稀釋不同的極端言論主題之間的聯係。

左下角的策略,則是將相互矛盾的極端言論同時曝光給同一個用戶,讓二者相互牽製,從而削減極端言論的影響力。

該文指出,四種策略需要有所權衡,才能達到對極端言論的最佳管控效果。

如何應對極端言論帶來的挑戰

由於人群極化與國家對立,互聯網上各類極端的言論也日漸增多,極端言論的管控成為了一個世界性的問題。國外的 3K黨、新納粹、ISIS

等毒瘤思想,甚至發展成了嚴重影響社會安全的危險因素。

在傳統的紙媒時代,若想打掉一家宣傳極端言論的報紙,僅需幾個核心成員就能做到,並對某類極端思想予以毀滅性的打擊。但在社交媒體上,傳統智慧不再管用,反而會產生更大的副作用。至於極端思想的形成,其影響因素也由社交網絡的鄰裏實體關係,轉換到了虛擬空間上。這使得算法的影響變得顯著,也使之前不可行的由下而上的方法(例如前文提到的後兩種策略)變得可行。但由於極端言論的多樣性和複雜性,人們對其的管控仍需多種方法協作。

除了應用在極端言論的管控上,文本的結論是否對兒童色情的傳播、非法人口交易、傳銷組織的人員招募等其他暗網也適用呢?這一點作者並沒有給出明確的回答,但這是一個值得研究的問題。個人的猜測是,對於一切非法的信息傳遞網,狡兔三窟的個體使針對某一平台的打擊很難達到預期的效果。

正是由於這篇文章得出的結論具有反常識的特征,因此有潛力應用到更廣泛的領域,且對現實的重大政策製定有具體的指導意義。

Nature 論文題目:

Hidden resilience and adaptive dynamics of the global online hate

ecology

×

華客網:刪帖、屏蔽關鍵詞能阻止極端言論傳播嗎?不能