在矽谷網路大廠裡,多元文化正在向「監獄幫派」演變嗎?

前Glean和谷歌搜尋創始團隊成員Deedy Das在X上轉發一則有關Meta實習經歷的帖子,引發有關矽谷互聯網大廠中“監獄幫派”現象的討論:

「在大科技公司裡,有些上百名員工的部門,由中國或印度的副總裁領導,這些部門幾乎100%是單一種族,以至於不說英語……就像監獄裡的幫派一樣。”

大家心知肚明。

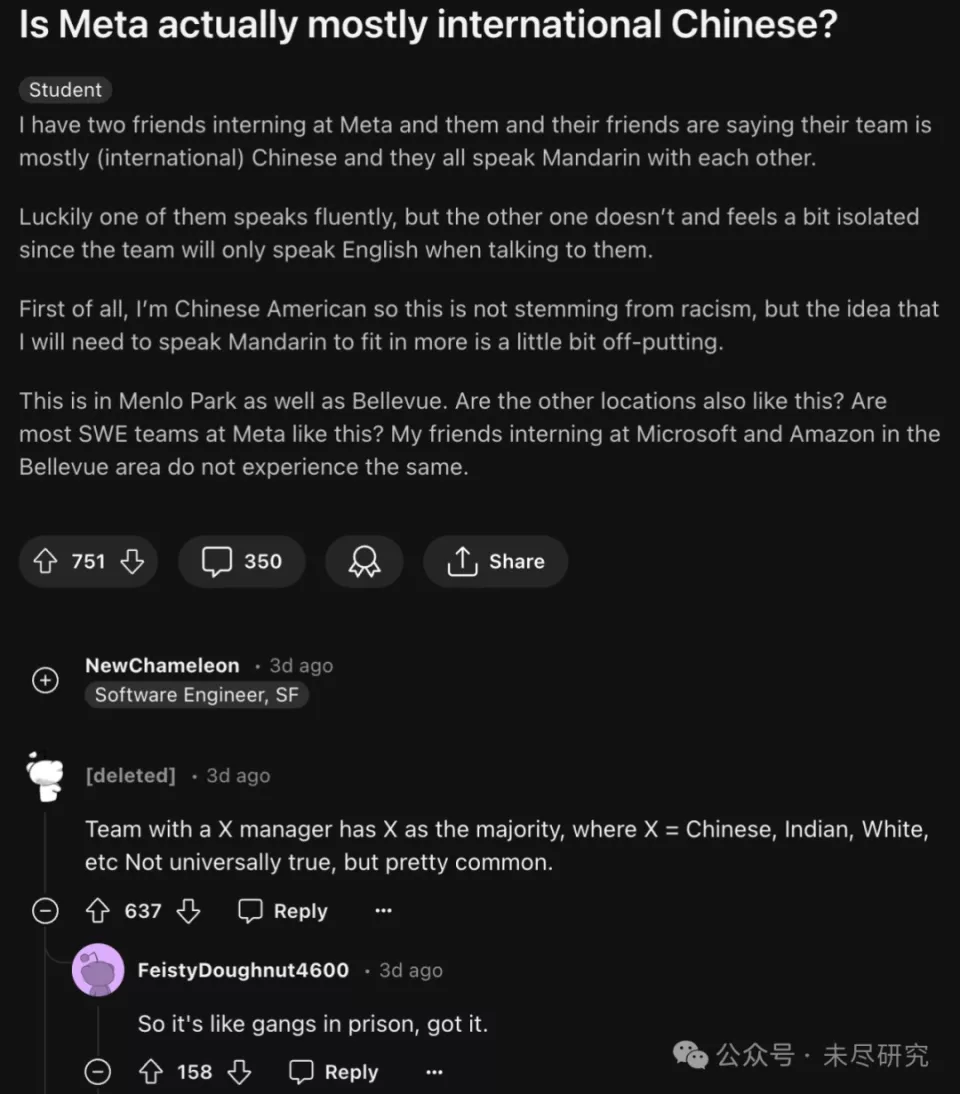

po主在貼文中提到了朋友在Meta實習中遇到的事情,並提出了自己的困惑:

『Meta 裡都是華人嗎?

我有兩個朋友在Meta 實習,他們團隊成員主要是華人,彼此之間都講普通話。

其中一個朋友能流利地說普通話,但另一個不會說,因此感覺有點被孤立,因為團隊只會在與他交談時使用英語。

首先,我是美籍華人,所以我發這個帖子不是出於種族歧視,但需要講普通話才能更好地融入團隊,這點讓我有點不舒服。

這是在Menlo Park 和Bellevue 地區。其他地方也是這樣嗎? Meta大多數軟體工程團隊是這樣的嗎?我在微軟和亞馬遜實習的朋友在Bellevue 地區沒有類似經驗。 ’

原帖截圖中出現了兩則評論。

網友NewChameleon說,

『團隊中如果有某個X 國籍的經理,那麼X 國籍的人就會佔多數,這裡的X 可以是華人、印度人、白人等等。這種情況雖然不是普遍存在,但很常見。 ’

網友FeistyDoughnut4600則更一針見血地指出:

『所以這就像監獄裡的幫派一樣,明白了。 ’

Deedy轉發這篇貼文時附上的留言也為「監獄幫派」這個詞劃了重點:

『在大型科技公司中,有些組織有超過100名員工,由華人或印度裔副總裁領導,這些組織幾乎完全是單一民族的,他們甚至不說英語。

為什麼會這樣呢?因為每個人都害怕大聲說出自己的想法。 「就像監獄裡的幫派一樣。」’

Deedy也補充表示:

『如果說,他們自己不主動排除群體外的人,新候選人就會自己選擇不加入這些組織。

我不認可刻意地在組織中註入多樣性,但現在這種做法太糟糕了。這些組織像一家迷你公司一樣運作,有自己內部的小政治。 ’

網友的評論出奇地一致:

就像迷你公司一樣,裡面甚至有內部政治鬥爭。任何大公司都是這樣的。

你僱用什麼樣的人就得到什麼樣的結果,包括他們的能力和語言。這個組織是自我選擇的。

有什麼好大驚小怪的呢?在印度,人們甚至會依照地區組成小團體。特倫甘納語團隊或泰米爾語團隊非常常見。

矽谷DEI文化的大起大落

矽谷擁有來自世界各地的人才,多樣化的語言和文化成為矽谷科技公司的特色之一。矽谷的公司也意識到,不同背景、技能和經驗的人才對於推動創新和業務成功的重要性。為了吸引和保留人才,這些公司正在努力創造一個包容性的工作場所,讓所有員工都覺得自己被接納、尊重並且能夠充分發揮潛力。

DEI文化由此應運而生。 DEI是”Diversity, Equity, and Inclusion”的縮寫,意為”多元化、公平性和包容性”。 DEI文化的關鍵在於讓每個人都感到被歡迎、被尊重和重視。

然而,近年來DEI在矽谷遭遇了一波「大起大落」。

在2020年的「黑人的命也是命」(Black Lives Matter)抗議活動之後,各公司都承諾要促進其成員的性別和種族多樣性。許多公司紛紛聘請了史上第一個首席多元化和包容官。根據就業網站Indeed的數據,在喬治·弗洛伊德(George Floyd)被殺後的三個月裡,DEI的招募資訊激增了123%。

但好景不長。在席捲科技業的裁員潮之下,「多元」、「多元化」這樣的標籤被無情的現實撕了個粉碎:

根據Indeed數據,到2023年年中,與一年前同期相比,與DEI相關的職缺發布驟降44%。這一數字與2020年至2021年期間形成鮮明對比,當時這些職位增加了近30%。

諸如Google和Meta等科技巨頭都削減了DEI專案規模。為矽谷科技公司DEI專案提供服務的某業內人士表示,某些企業的DEI預算削減幅度高達90%。

AI時代的DEI

被打破的不僅是承諾,還有更多利害關係。

Hella Social Impact是一家提供DEI培訓服務的公司,其創辦人Stefania Pomponi直言不諱地對客戶表示:「員工是你們公司最寶貴的資產,DEI計畫預算的削減將影響你們的業務」。她指的是關於多元化團隊產生更高績效結果的各種研究。

當下,這些科技公司正推動十年來最大的技術轉變——人工智慧。人工智慧以先前難以預見的速度飛速發展,DEI工作現在比以往任何時候都更加重要。需要多樣化的視角來確保AI產品沒有偏見,並且能夠反映他們所服務用戶的真實需求。

以圖像辨識為例。 Google和Facebook兩家科技巨頭都曾經鬧過笑話。 Google Photos 將黑人的照片標記為“大猩猩”,Facebook將影片中的黑人識別為“靈長類動物”。

此類演算法偏見與AI核心技術之一機器學習的技術環節有關。例如,機器學習所使用的資料集如果帶有來自現實社會的偏見,那麼演算法就會習得這些偏見。換句話說,如果AI歧視黑人、歧視女性,很大一部分原因是現實生活中本來就存在歧視黑人、歧視女性的現象。

即使透過對齊讓AI符合倫理與政治正確,AI也是「心知肚明」。

華客|新聞與歷史:硅谷大廠里,不講普通話,已經會被排斥了?